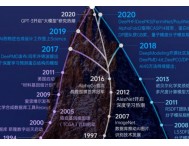

Groq成立于2016年,由前谷歌员工Jonathan Ross创立。他曾发明了驱动谷歌机器学习软件的张量处理单元(TPU),这两项技术当时为AlphaGo提供了重要的技术支撑。

字节跳动发布万卡集群系统MegaScale论文

2月23日,字节跳动发布万卡集群论文,展示了构建和部署 MegaScale 的设计、实施和工程经验,这是一个用于训练超过1万个GPU规模的大型语言模型生产系统。

在12288个GPU上训练175B LLM模型时,MegaScale实现了55.2%的模型FLOP利用率 (MFU),与Megatron-LM相比,MFU提高了1.34倍。

中国为人工智能初创企业提供14万至28万美元的“算力券”

为了支持蓬勃发展的人工智能行业,中国向初创企业提供“算力券”,来降低企业数据中心运营相关的成本。至少有17个中国城市政府承诺提供这些补贴,代金券价值从14万美元到28万美元不等。

meta 推出2个24K GPU集群

3月13日,meta披露了有关万卡集群的硬件、网络、存储、设计、性能和软件的详细信息,并声称到2024年底将完成350000个英伟达H100 GPU集群的构建。届时,其整个资源池计算能力将相当于近600000个H100。

Cerebras发布了世界上最快的芯片,拥有4万亿个晶体管

3月14日,Cerebras发布了大尺寸芯片WSE-3,包含4万亿个晶体管,在相同的功耗和价格下,WSE-3的性能是之前记录保持者WSE-2的两倍。

相比H100 GPU ,WSE-3大了57倍,内核数量增加了52倍,芯片内存增加了800倍,内存带宽增加了7000倍,结构带宽增加了3700倍以上。这些都是芯片实现高性能的基础。

WSE-3是专为训练业界最大的AI模型而打造的,基于5纳米制程、将为Cerebras CS-3人工智能超级计算机提供动力,通过90万个人工智能优化的计算核心,提供每秒125 petaflops峰值AI性能(1 petaflops是指每秒1万亿次浮点运算)。

AI模型

大语言模型

谷歌发布多模态模型Gemini 1.5 Pro,支持100万token上下文

2月16日,谷歌发布多模态大模型Gemini 1.5 Pro,建立在谷歌Transformer和MoE架构的领先研究之上。

通过一系列机器学习创新,谷歌增加了Gemini 1.5 Pro的上下文窗口容量,并实现在生产中运行高达100万个Token,远超32k的Gemini 1.0、128k的GPT-4 Turbo、200k的Claude 2.1。

Gemini 1.5 Pro可以一次性处理大量信息——包括1小时的视频、11小时的音频、超过30000行代码的代码库或超过700000个单词。

谷歌发布开源大模型Gemma

2月22日,谷歌推出了“开源”大模型Gemma。Gemma采用了与Gemini相同的技术,由谷歌DeepMind与谷歌其他团队共同合作开发,在拉丁文中意为 “宝石”。

Gemma包括两种权重规模的模型:Gemma 2B 与Gemma 7B,每种规模都有预训练与指令微调版本。同时,谷歌还推出了一系列工具,旨在支持开发者创新,促进合作,并指导如何负责任地使用Gemma模型。

Mistral获微软投资,发布旗舰模型Mistral Large

2月27日,Mistral AI发布Mistral Large旗舰模型,并且推出对标ChatGPT的对话产品:Le Chat。

Mistral Large达到了顶级的推理能力。它可以用于复杂的多语言推理任务,包括文本理解、转换和代码生成。

据Mistral AI CEO Arthur Mensch透露,开发这款新模型的成本不到2000万欧元(约合2200万美元)。

同时,微软宣布与Mistral AI达成深度合作,并对其进行了投资。未来,Mistral AI直接将模型资源放在微软云当中售卖,成为OpenAI之后第二家在微软Azure云平台上提供商业AI模型的公司。

Anthropic发布Claude 3模型,全面超越GPT-4

3月4日,Anthropic推出了最新的Claude 3大模型。